深度学习的loss一般收敛到多少? - 知乎

1. Loss值能否作为衡量模型性能的指标 之所以说几乎不能,是因为对于分类问题,模型的loss值与咱们关心的模型指标(metrics)有一定的相关性,但不是绝对相关,所以loss值本身不能作为 …

深度学习中loss和accuracy的关系? - 知乎

loss 的具体形式取决于机器学习任务的类型。 例如,在回归问题中,常用的 loss 函数包括平方损失、绝对损失和对数损失;在分类问题中,常用的 loss 函数包括交叉熵损失和 Hinge 损失。

keras深度学习框架输出acc/loss,val_acc/val_loss,什么意思?

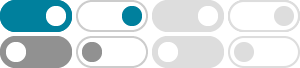

上图就是一个很典型的过拟合现象,训练集的 loss 已经降到0了,但是验证集的 loss 一直在上升,因此这不是一个很好的模型,因为它太过拟合了。 如果我们非要用这个模型,应该在5~10 …

深度学习的loss一般收敛到多少? - 知乎

深度学习的loss一般收敛到多少? 计算机视觉的图像L2损失函数,一般收敛到多少时,效果就不错了呢? 显示全部 关注者 111

有哪些「魔改」loss函数,曾经拯救了你的深度学习模型? - 知乎

类似的Loss函数还有IoU Loss。 如果说DiceLoss是一种 区域面积匹配度 去监督网络学习目标的话,那么我们也可以使用 边界匹配度去监督网络的Boundary Loss。 我们只对边界上的像素进 …

深度学习当中train loss和valid loss之间的关系? - 知乎

Nov 8, 2018 · 深度学习当中train loss和valid loss之间的关系? 深度学习当中train loss和valid loss之间的关系,在一个caption实验当中,使用交叉熵作为损失函数,虽然随着训练,模型的 …

究竟什么是损失函数 loss function? - 知乎

如何设计loss函数? Loss函数和你任务的评价准则越相关,二者越接近越好。 如果你任务的评价准则是F1-score(不可导),但一直在使用CrossEntropy Loss来迭代模型,二者之间虽然相关 …

深度学习的多个loss如何平衡? - 知乎

多个loss引入 pareto优化理论,基本都可以涨点的。 例子: Multi-Task Learning as Multi-Objective Optimization 可以写一个通用的class用来优化一个多loss的损失函数,套进任何方法 …

神经网络模型train_loss下降,val_loss一直上升是什么原因? - 知乎

train_loss 不断下降, test_loss 不断上升,和第2种情况类似说明网络过拟合了。 应对神经网络过拟合的方法包括: 简化模型。 通过减少神经网络层数或神经元数量来降低模型复杂度,从而 …

如何分析kaiming新提出的dispersive loss,对扩散模型和aigc会带 …

Dispersive Loss 的目的: 是最大化表示的 分散性。 当不进行 \ell_2 归一化时,特征向量的 范数(长度) 是被允许自由变化的。 如果模型为了最小化 Dispersive Loss,它会倾向于让特征向 …